У зв’язку з резонансною домовленістю OpenAI з Міністерством оборони США, Кейтлін Каліновскі покинула пост очільниці підрозділу технічного забезпечення компанії.

«Це було непросте рішення. Штучний інтелект відіграє важливу роль у гарантуванні державної безпеки. Однак, відстеження за громадянами Америки без судової ухвали та смертельна автономія без людської згоди — це аспекти, які потребують більшої уваги, ніж їм приділяють зараз», — зазначила вона.

Каліновскі працювала в Apple над технічною складовою комп’ютерів Mac, пізніше перейшла до Meta, ставши однією з провідних інженерок у відділі Reality Labs. У 2024 році вона приєдналася до OpenAI, очоливши сферу робототехніки та споживчого технічного забезпечення.

У своїй заяві вона підкреслила, що рішення було «питанням принципу, а не людей», висловивши «глибоку повагу» до генерального директора OpenAI Сема Альтмана та команди стартапу.

«На мою думку, про оголошення заявили занадто швидко, без визначення обмежень. Це насамперед питання керівництва. Вони занадто важливі, щоб поспішати з укладанням угод», — додала Каліновскі.

Представник OpenAI підкреслив, що угода з Пентагоном «створює оперативний шлях для відповідального використання ШІ в інтересах національної безпеки, одночасно чітко окресливши заборонені межі: ніякого внутрішнього стеження та автономної зброї».

«Ми розуміємо, що в людей є стійкі переконання щодо цих питань, і будемо продовжувати обговорювати їх із працівниками, урядом та суспільством у всьому світі», — додав він.

Угоду між OpenAI і Пентагоном уклали в кінці лютого — незабаром після того, як переговори між Anthropic і Міністерством оборони зайшли в безвихідь.

Згодом Альтман визнав, що угода вийшла «квапливою» і з точки зору іміджу стартапу «виглядає не зовсім добре».

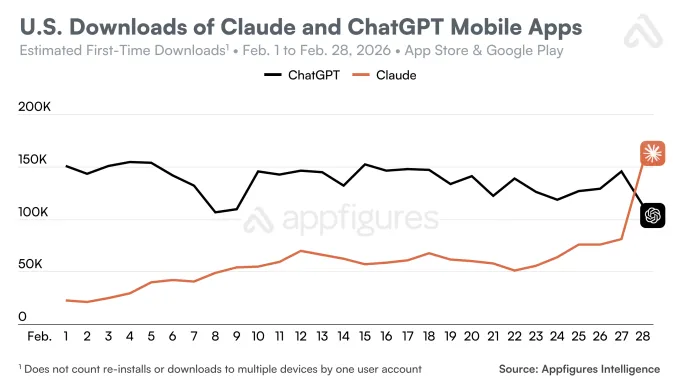

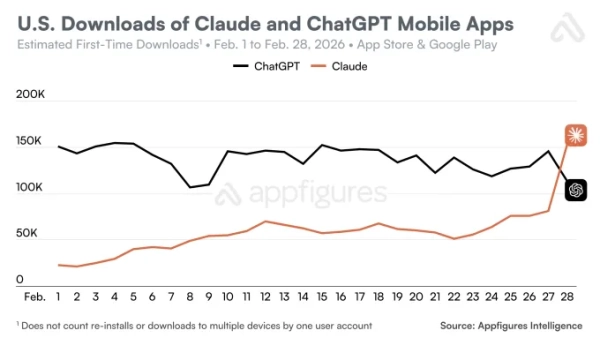

Ситуація вплинула на популярність ChatGPT і Claude. Число видалень першого чатбота збільшилася на 295%, а другий піднявся на вершину рейтингу App Store.

Завантаження мобільних додатків Claude і ChatGPT в США. Джерело: Appfigures.

Протистояння влади з Anthropic

У липні 2025 року Міністерство оборони США уклало контракти на суму до $200 млн з Anthropic, Google, OpenAI і xAI на розробку рішень ШІ в галузі безпеки.

У січні 2026 року WSJ повідомила про ризик припинення угоди з Anthropic. Непорозуміння виникли через сувору етичну політику стартапу. Правила забороняють використовувати модель Claude для масового спостереження й автономних летальних операцій.

У лютому 2026 року армія США залучила Claude в операції із захоплення президента Венесуели Ніколаса Мадуро, після чого конфлікт загострився.

Генеральний директор компанії Даріо Амодей зустрівся з міністром оборони Пітом Гегсетом для обговорення ситуації. Відомство висунуло ультиматум: Anthropic зобов’язана прийняти урядові умови до 27 лютого.

Амодей заявив, що швидше не співпрацюватиме з Пентагоном, ніж погодиться на використання своїх технологій, яке може «похитнути, а не захистити демократичні цінності».

Наприкінці лютого президент США Дональд Трамп доручив усім федеральним відомствам протягом шести місяців повністю відмовитися від використання технологій Anthropic.

Він назвав стартап «неконтрольованою» компанією під керівництвом людей, які «не мають уявлення, що таке реальний світ».

Пентагон офіційно визнав Anthropic «загрозою для ланцюжка постачання» — це ставить під удар бізнес фірми з іншими підрядниками уряду. Microsoft і Google заявили, що й надалі надаватимуть компанії свої продукти.

Дійде до суду

Амодей заявив, що його компанія оскаржить у суді рішення Міністерства оборони про визнання фірми загрозою для ланцюжка постачання. Воно «юридично необґрунтоване», вважає підприємець

У зверненні йдеться, що рішення Пентагону не стосується переважної більшості клієнтів Claude.

За словами Амодея, компанія вела продуктивні переговори з Міноборони протягом декількох днів, однак вони зірвалися після витоку внутрішньої службової записки. У ній генеральний директор охарактеризував відносини OpenAI з відомством як «більше показову демонстрацію безпеки, ніж реальний захист від ризиків».

Амодей вибачився за витік, заявивши, що компанія ненавмисно розкрила зміст меморандуму і не давала вказівок комусь це робити.

«Нам невигідно погіршувати ситуацію», — написав він.

Глава стартапу підкреслив, що документ був написаний протягом декількох годин після серії оголошень про те, що Anthropic видалять з федеральних систем. Він вибачився за тон, назвавши той день «складним для компанії».

Амодей додав, що меморандум є «застарілою оцінкою» і не відображає «уважної та зваженої думки». За його словами, для фірми головним пріоритетом є забезпечення американським солдатам і фахівцям з національної безпеки доступу до важливих інструментів під час триваючих масштабних бойових операцій.

Anthropic й надалі забезпечуватиме Міністерство оборони своїми моделями «за номінальною вартістю» стільки, скільки буде потрібно.

Ексрадник Білого дому з питань штучного інтелекту Дін Болл зазначив, що компанії буде важко оскаржити рішення Пентагону.

«Суди досить неохоче ставлять під сумнів рішення уряду про те, що є питанням національної безпеки, а що ні. Для цього треба подолати дуже високий бар’єр. Але це не неможливо», — зазначив експерт.

Нагадаємо, у лютому Anthropic пом’якшила ключову політику безпеки, пояснивши це необхідністю зберегти конкурентоспроможність.