Фірма Anthropic оприлюднила Claude Opus 4.7 — найбільш вражаючу на сьогодні модель сімейства Opus.

Вітайте Claude Opus 4.7 — нашу найбільш компетентну модель Opus на даний момент.

Вона пильніше виконує довготривалі завдання, точніше дотримується вказівок і перевіряє свої відповіді перед відправленням.

Можете доручати їй найважчу роботу з меншим наглядом. pic.twitter.com/PtlRdpQcG5

— Claude (@claudeai) April 16, 2026

Нова ітерація відкрита для всіх платних клієнтів Claude та в API — $5 за 1 млн вхідних токенів, $25 — за 1 млн вихідних.

Головні покращення

Opus 4.7 найкраще показує себе у важких задачах. Клієнти покладаються на неї в тому, що раніше вимагало суворого контролю, відзначили розробники.

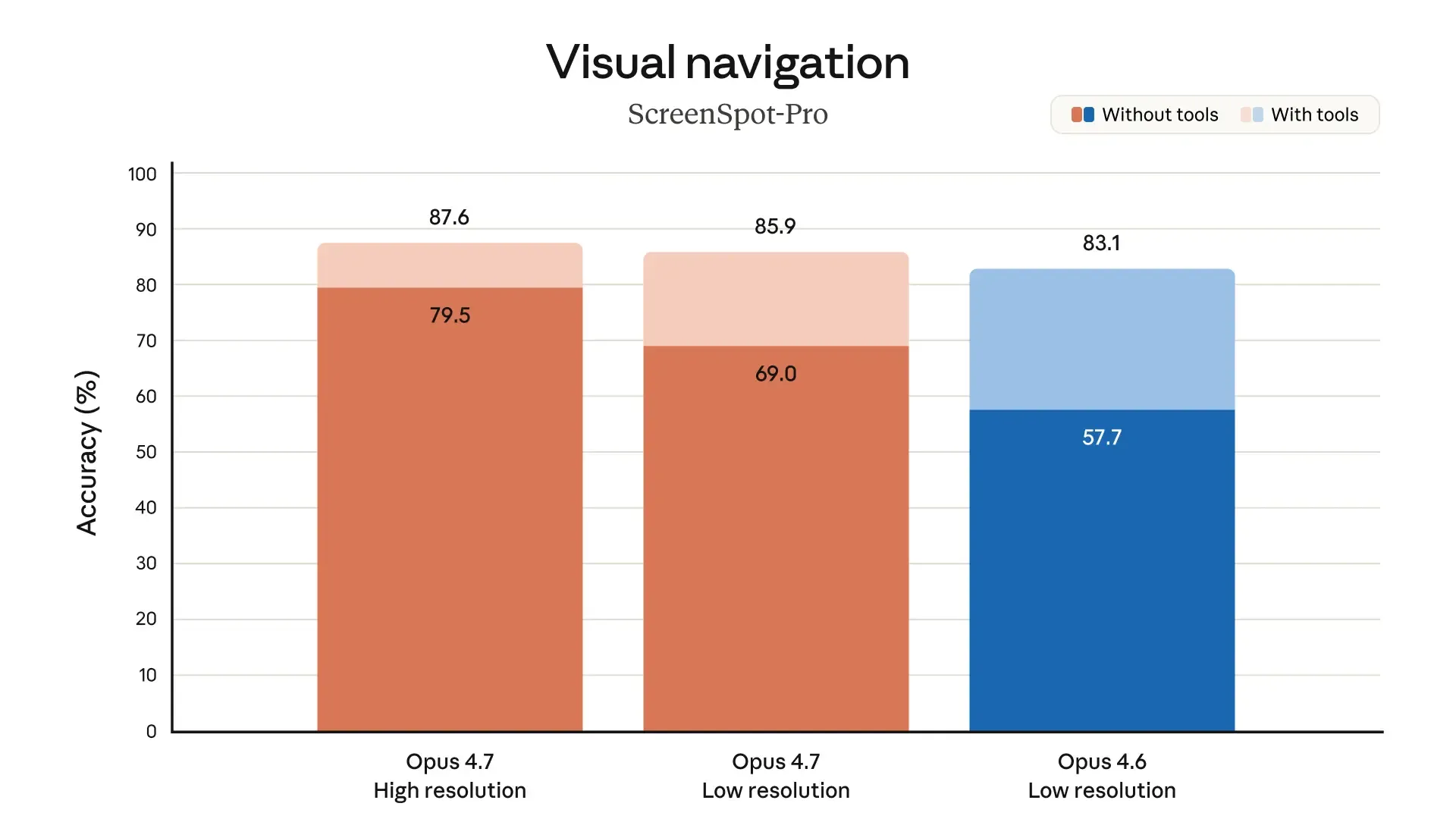

В агентному програмуванні модель перевершила попередницю на 10%, в опрацюванні візуальних даних — на 13%. За іншими показниками приріст більш стриманий.

Модель отримала значно розширені візуальні можливості: обробляє світлини до 2576 пікселів по довгій стороні (приблизно 3,75 Мп) — більш ніж втричі більше, ніж у минулих версій Claude.

Джерело: Anthropic.

Opus 4.7 чіткіше дотримується інструкцій. Промпти, створені для попередніх моделей, можуть давати непередбачувані результати: вони вільно трактували інструкції, тоді як нова версія сприймає їх дослівно. Рекомендовано переналаштувати запити.

Окрім того, остання Claude навчилася запам’ятовувати інформацію між сеансами — зберігає нотатки у файлах і може використовувати їх у кожній новій розмові.

Anthropic додала в Opus 4.7 новий рівень зусиль xhigh («екстра високий») — між high («високий») і max («максимальний»). Він дає змогу точніше коригувати баланс між глибиною аналізу та швидкістю відповіді.

У Claude Code рівень зусиль за замовчуванням підвищено до xhigh для всіх планів.

Інші нововведення:

- Task budgets (публічна бета API) — регулювання витратою токенів;

- /ultrareview — виділена сесія перевірки коду в Claude Code;

- режим auto для користувачів Max — Claude самостійно приймає рішення.

Обмеження кіберможливостей

Opus 4.7 слабша за Mythos Preview у кібербезпеці. Anthropic навмисно зменшила ці можливості під час тренування. Модель має вбудований захист, що блокує заборонені та небезпечні запити.

«Те, що ми дізнаємося з реального розгортання цих захисних механізмів, допоможе нам просуватися до нашої кінцевої мети — широкого випуску моделей класу Mythos», — зауважила команда стартапу.

Фахівцям з безпеки, які прагнуть використовувати Opus 4.7 у законних цілях (дослідження вразливостей, пентести), в Anthropic запропонували приєднатися до нової програми Cyber Verification.

Для клієнтів обмеження стали проблемою. Деякі клієнти нарікають, що модель відмовляється писати код, оскільки «бачить шкідливе ПЗ у кожному запиті».

Вона підозрює, що все є шкідливим ПЗ, і все одно відмовляється писати код після підтвердження, що шкідливого ПЗ немає pic.twitter.com/YXpaoNV8YG

— Hanh Nguyen (@fashiongiik) April 16, 2026

Відповідь OpenAI

Компанія OpenAI представила «велике оновлення» Codex, яке поки доступне лише на macOS.

Codex для (майже) всього.

Зараз він може використовувати застосунки на вашому Mac, під’єднуватися до більшої кількості інструментів, створювати світлини, вчитися на попередніх діях, запам’ятовувати, як вам зручно працювати, і брати на себе поточні та повторювані завдання. pic.twitter.com/UEEsYBDYfo

— OpenAI (@OpenAI) April 16, 2026

Нова версія здатна взаємодіяти із застосунками на комп’ютері користувача: бачити екран, клікати й друкувати власним курсором. На Mac підтримується паралельна робота кількох агентів без перешкод для іншого софту.

Вбудований браузер, плагіни й життєвий цикл розробки

Codex оснащений вбудованим браузером: сторінки можна коментувати безпосередньо, надаючи агенту точні вказівки. Це корисно для фронтенд- та ігрової розробки.

З можливістю роботи з комп’ютером на macOS Codex зараз може використовувати будь-який застосунок, бачачи, клікаючи та вводячи текст власним курсором.

Він працює у фоновому режимі, не перехоплюючи ваш комп’ютер, виконуючи завдання на кшталт ітерацій фронтенду, тестування застосунків чи будь-яких робочих процесів без доступного API. pic.twitter.com/iO9iubLZX9

— OpenAI (@OpenAI) April 16, 2026

Розробники планують розширити керування браузером за межі локального середовища.

Також Codex отримав підтримку gpt-image-1.5 для генерації та ітерацій зображень. Разом зі скриншотами та кодом це дає змогу створювати візуальні концепти, фронтенд-дизайн, макети й ігри в єдиному інтерфейсі.

Зараз ви можете генерувати та ітерувати зображення за допомогою gpt-image-1.5 у Codex, створюючи фронтенд-дизайни, макети, ігрові ресурси тощо, не виходячи зі свого робочого процесу.

Використання входить до вашого облікового запису ChatGPT, жодного API-ключа не потрібно. pic.twitter.com/ay17I3Nxoa

— OpenAI (@OpenAI) April 16, 2026

OpenAI випустила понад 90 додаткових плагінів, що об’єднують навички, інтеграції із застосунками та MCP-сервери. Серед них — Atlassian Rovo для роботи з JIRA, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite, Neon by Databricks, Remotion, Render і Superpowers.

У Codex додали підтримку коментарів GitHub, кількох вкладок термінала та підключення до віддалених devbox через SSH (в альфа-версії).

Клієнти можуть відкривати файли прямо в бічній панелі з розширеним переглядом PDF, таблиць, слайдів і документів, а також користуватися новою панеллю зведення для відстеження планів агента, джерел та артефактів.

Пам’ять і планування

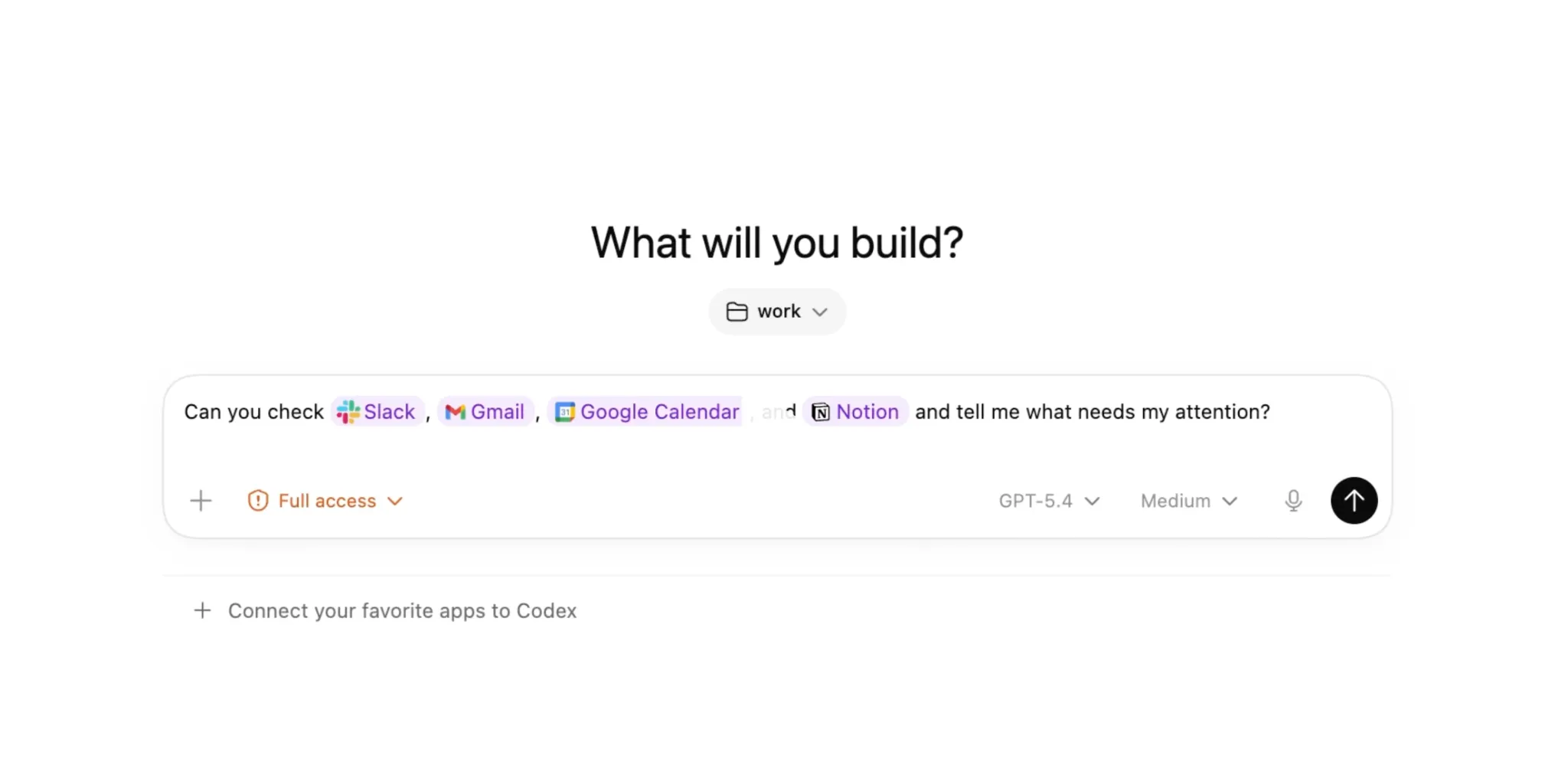

Codex навчився планувати майбутню роботу й автоматично відновлювати виконання довгострокових завдань — потенційно на дні чи тижні. Команди використовують автоматизацію для різних цілей: від запитів на перевірку коду до відстеження задач у Slack, Gmail і Notion.

Джерело: OpenAI.

Розробники поліпшили пам’ять асистента. Codex навчився запам’ятовувати корисний контекст із минулих діалогів — особисті вподобання та виправлення.

Модель також активно пропонує корисні дії, продовжуючи роботу з того місця, де зупинився клієнт. Наприклад, агент може знайти відкриті коментарі в Google Docs, витягнути контекст зі Slack, Notion і кодової бази, а потім видати пріоритетний список дій.

Нова модель GPT

Додатково OpenAI представила модель ШІ GPT‑Rosalind для прискорення розробки ліків.

Вітайте GPT‑Rosalind — нашу передову міркувальну модель, створену для підтримки досліджень у біології, пошуку ліків і трансляційній медицині. pic.twitter.com/PubLU0FkSv

— OpenAI (@OpenAI) April 16, 2026

Її названо на честь англійської біофізикині Розалінд Франклін, чиї дослідження допомогли розкрити структуру ДНК і заклали основи сучасної молекулярної біології.

Розробники зауважили, що у США на розробку нового препарату йде в середньому 10–15 років. Майбутнє препарату значною мірою визначається на початкових етапах досліджень. Найбільші труднощі пов’язані з аналізом величезних масивів наукових публікацій і вузькоспеціалізованих баз даних.

Завдання GPT‑Rosalind — бути асистентом біолога: підсумовувати наукові тексти, формулювати гіпотези, будувати плани експериментів і опрацьовувати інформацію. Модель особливо сильна в задачах, пов’язаних із білками, генами та подібними біологічними структурами.

На бенчмарку BixBench (реальний біоінформатичний аналіз) GPT‑Rosalind показала один із найкращих результатів серед моделей з опублікованими даними.

На LABBench2 рішення випередило GPT‑5.4 у шести з 11 завдань. Найбільший відрив — у CloningQA, де потрібно проєктувати ДНК і ферменти для протоколів молекулярного клонування.

Додатково OpenAI виклала безплатний плагін Life Sciences для Codex на GitHub. Він доступний усім клієнтам і дає змогу під’єднати ШІ до більш ніж 50 публічних наукових баз даних і профільних інструментів.

Нагадаємо, 16 квітня компанія Google випустила Gemini 3.1 Flash TTS — оновлену модель синтезу мовлення на базі покоління Gemini 3.