Корпорація Anthropic висуває звинувачення проти трьох китайських стартапів, які займаються штучним інтелектом — DeepSeek, Moonshot і MiniMax — у проведенні масштабної діяльності з використання Claude для вдосконалення власних моделей.

Лабораторії з КНР ініціювали більше 16 мільйонів взаємодій із чат-ботом, використовуючи приблизно 24 000 фальшивих облікових записів, що є порушенням правил використання та географічних обмежень.

«Ми з великою впевненістю встановили зв’язок кожної кампанії з певною компанією на основі співвідношення IP-адрес, метаданих запитів, інфраструктурних характеристик і підтверджень від партнерів у галузі. Їх метою були найунікальніші функції Claude: агентне мислення, застосування інструментів і кодування», — зазначили в Anthropic.

Компанії використовували дистиляцію — процес навчання менш потужної нейронної мережі на результатах більш сильної.

Це поширений і законний спосіб. Провідні ШІ-лабораторії часто дистилюють свої моделі, щоб створювати їх компактні та більш доступні версії для споживачів.

«Проте, це може застосовуватися і нелегально: конкуренти поліпшують здібності за рахунок чужих LLM за короткий час і з меншими витратами в порівнянні з незалежною розробкою», — зазначено у блозі Anthropic.

У компанії підкреслили, що час для реагування на подібну «крадіжку» обмежений, а загроза виходить за рамки однієї компанії чи регіону. Для її усунення необхідні швидкі та злагоджені дії з боку галузі, регуляторів і глобального ШІ-співтовариства.

Чому це ризиковано

В Anthropic роз’яснили небезпеки такого підходу: незаконно дистильовані моделі не мають необхідних захисних механізмів — це створює проблеми для національної безпеки.

Американські компанії запроваджують системи, які перешкоджають використанню штучного інтелекту для створення біологічної зброї, руйнівних кібератак та інших небезпечних дій. Моделі, створені через незаконну дистиляцію, не мають подібних обмежень.

Іноземні лабораторії можуть впроваджувати незахищені можливості у військові та розвідувальні системи, дозволяючи авторитарним урядам застосовувати передовий ШІ для кібератак, дезінформації та масового спостереження, додали в компанії.

Методи протидії

Експерти Anthropic підтримали експортні обмеження для підтримки лідерства США у ШІ. На їхню думку, дистиляційні атаки руйнують ці заходи, дозволяючи закордонним лабораторіям зменшувати технологічний розрив.

«За відсутності прозорості таких атак швидкий прогрес китайських лабораторій невірно трактується як доказ неефективності експортних обмежень. Насправді їхні досягнення значною мірою залежать від вилучення можливостей американських моделей, а масштабування такого підходу вимагає доступу до передових чипів», — йдеться в блозі компанії.

Anthropic перерахувала власні методи боротьби:

- вдосконалення системи виявлення патернів дистиляції;

- обмін технічними індикаторами з іншими лабораторіями та хмарними провайдерами;

- посилення перевірки освітніх і дослідницьких акаунтів;

- застосування контрзаходів, які знижують ефективність нелегальної дистиляції.

Це не перше подібне звинувачення. У січні 2025 року, незабаром після відомого випуску DeepSeek-R1, компанію запідозрили у крадіжці даних в OpenAI.

Продовження конфронтації з Пентагоном

Генеральний директор Anthropic Даріо Амодей зустрінеться з міністром оборони Пітом Хегсетом у Пентагоні для обговорення шляхів використання ШІ-моделей компанії військовими.

Останнім часом між сторонами виникли розбіжності — Anthropic виступає проти використання штучного інтелекту для масового стеження за громадянами США і створення автономної зброї. У Міноборони чітко дали зрозуміти, що мають намір використовувати LLM «для всіх законних сценаріїв» без обмежень.

Ситуація дійшла до того, що в Пентагоні заявили про можливість розірвання угоди з Anthropic.

ШІ-сканер вразливостей

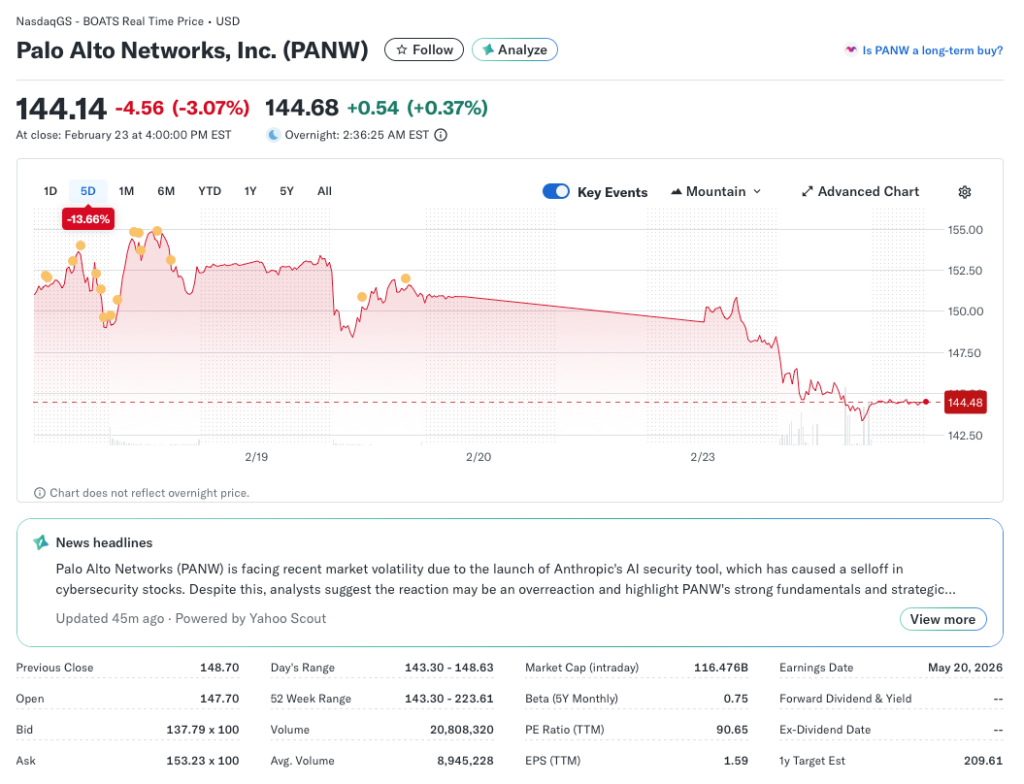

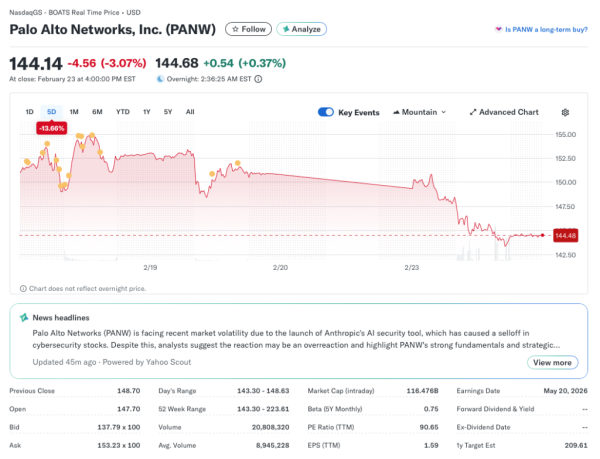

Акції провідних публічних компаній у сфері кібербезпеки впали після запуску Anthropic інструменту Claude Code Security — це ШІ-сканер вразливостей у коді.

На сайті компанії вказано, що новий сервіс «аналізує всю кодову базу на предмет вразливостей, перевіряє кожну знахідку для мінімізації помилкових спрацювань і пропонує виправлення».

Claude проводить аналіз «як досвідчений дослідник безпеки»: розуміє контекст, відстежує потоки даних, виявляє вразливості.

За інформацією VentureBeat, Claude Opus 4.6 виявила понад 500 критичних вразливостей, які існували десятиліттями, незважаючи на перевірки експертів.

П’ять найбільших за капіталізацією американських публічних компаній у сфері IT-безпеки продемонстрували двозначне падіння котирувань за останні п’ять днів на тлі появи ШІ-конкурента:

- Palo Alto Networks — -14%;

- CrowdStrike — -18%;

- Fortinet — -12%;

- Cloudflare — -18%;

- Zscaler — -19%.

Графік зміни акцій Palo Alto Networks. Джерело: Yahoo Finance.

Аналітики Wedbush заявили, що розпродаж акцій пов’язаний із побоюваннями навколо так званого AI Ghost Trade. На їхню думку, реакція ринку помилкова, а Palo Alto, CrowdStrike і Zscale доведуть свою цінність у 2026 році.

Нагадаємо, у лютому OpenAI разом з Paradigm презентувала EVMbench — інструмент для оцінки здатності ШІ-агентів виявляти, виправляти та використовувати вразливості в смартконтрактах.