Google впроваджує нові AI-інструменти на основі Gemini у браузер Chrome. Основні нововведення — генератор візуальних матеріалів Nano Banana, “Персональний інтелект” та “Автоперегляд”.

Now Chrome is even better with major updates to Gemini in Chrome. Easier to use. More personalized. And more helpful than ever, with Gemini 3. 🎢

Available in the U.S., auto browse for Google AI Pro and Ultra subscribers. pic.twitter.com/tILRW3osyO

— Chrome (@googlechrome) January 28, 2026

Інтеграція в інтерфейс

AI-помічник, інтегрований у вересні 2025 року як вікно, що виринає, зараз зафіксований на бічній панелі. Користувач може задавати питання про веб-сайт, який розглядає, чи інші відкриті розділи.

Серед покращень — обробка кількох розділів як єдиного цілого. Коли користувач відкриває різні сторінки одного ресурсу, цифровий асистент розглядає їх не окремо, а як єдину контекстну групу.

Раніше Gemini в Chrome був доступний лише для користувачів Windows та macOS. Після поновлення він відкритий також для власників Chromebook Plus.

Personal Intelligence

Корпорація застосовує нещодавно активовану функцію Personal Intelligence, що під’єднується до акаунтів Gmail, Search, YouTube та Google Photos та дозволяє ставити питання з урахуванням індивідуальних даних. Функціонал стане доступним впродовж наступних місяців.

Nano Banana

Інструмент дозволяє змінювати та коригувати зображення, використовуючи як посилання інші малюнки, знайдені в мережі Інтернет.

«Автоперегляд»

AI-агент може самостійно виконувати завдання: переходити за гіперпосиланнями, здійснювати купівлі або знаходити купони на знижку. Він проситиме втручатися у разі потреби оперувати конфіденційними відомостями.

Ризики безпеки

AI-браузери стають тенденцією в секторі штучного інтелекту, однак містять значні небезпеки для користувачів. У грудні 2025 року OpenAI повідомила про наявні слабкі місця.

Компанія підтвердила, що атаки типу “ін’єкція промпта” є проблемою.

“Подібна уразливість, як і шахрайство та соціальна інженерія в інтернеті, навряд чи колись будуть повністю викорінені”, — написали представники OpenAI.

Anthropic та Google дотримуються подібної позиції зі ставкою на багаторівневий захист та регулярні стрес-тести.

Agentic Vision у Gemini

Паралельно Google презентувала Agentic Vision — функцію, що дозволяє ретельніше вивчати файли в режимі AI-агента.

У компанії пояснили, що LLM нового покоління на зразок Gemini зазвичай обробляють інформацію про навколишній світ за один статичний погляд. Якщо вони не помічають незначні деталі на зразок серійного номера на мікросхемі або віддаленого дорожнього показника, то “роблять припущення”.

Agentic Vision у Gemini 3 Flash перетворює розуміння зображень зі статичної дії на активний процес. Модель діє як аналітик-людина:

- оцінює загальний вигляд;

- виділяє пріоритетні ділянки;

- створює план перевірки гіпотез;

- детально аналізує дрібні компоненти.

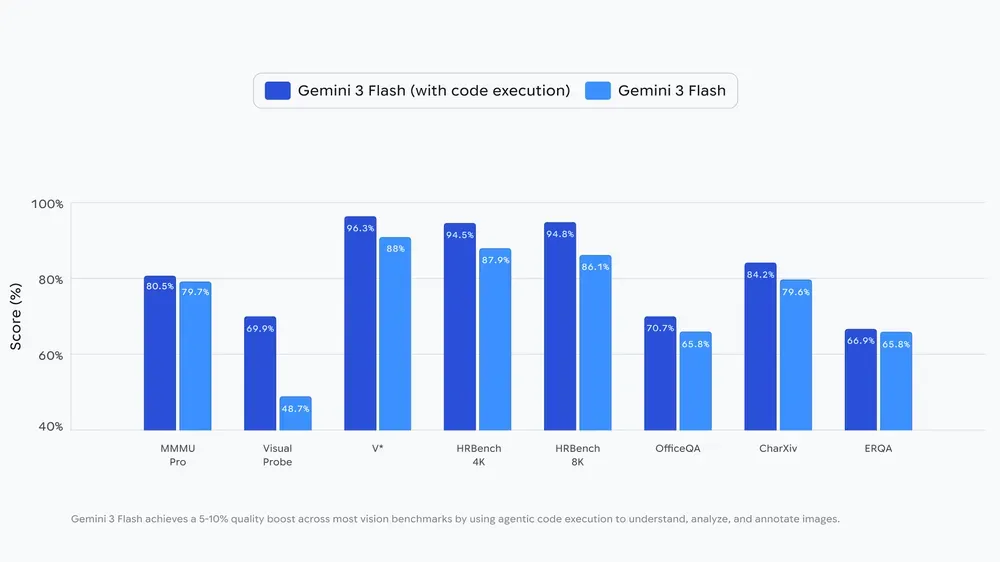

У результаті точність розпізнавання збільшується на 5–10%.

Джерело: Google.

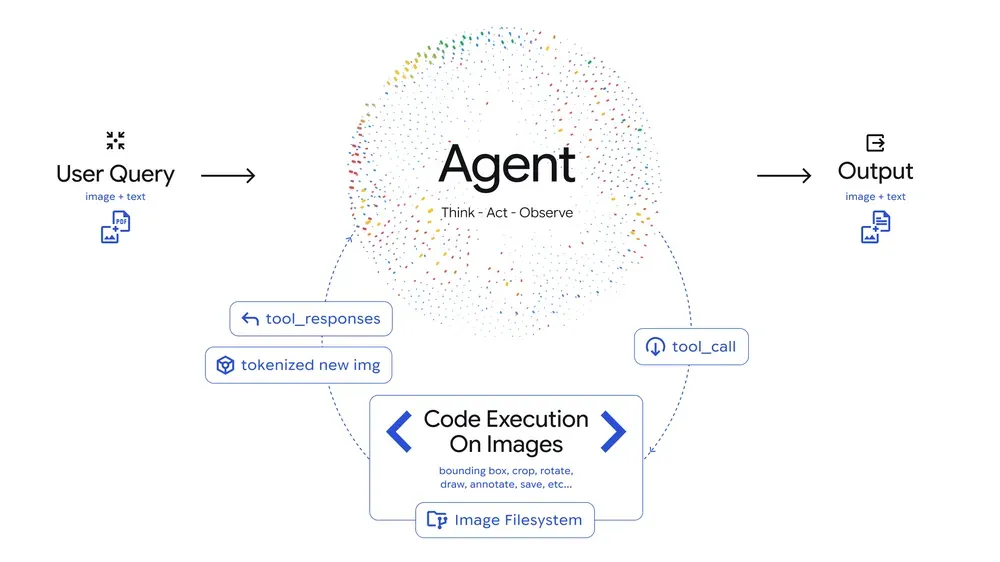

Agentic Vision впроваджує цикл “думати, діяти, спостерігати” у задачі розуміння зображень:

- думати — AI аналізує запит користувача та оригінальну ілюстрацію, формуючи багатоетапний план;

- діяти — модель генерує та виконує код Python для роботи з зображенням (кадрування, обертання);

- спостерігати — перетворене зображення додається в контекстне вікно моделі.

Джерело: Google.

Gemini 3 Flash навчена збільшувати зображення для виявлення дрібних деталей.

Бета-версія Agentic Vision доступна безкоштовно в Google AI Studio, Vertex AI, Gemini API для розробників та чат-боті Gemini в режимі Thinking.

Нагадаємо, у грудні 2025 року Google випустила мовну модель Gemini 3 Flash та зробила її стандартною у додатку Gemini та режимі AI у пошуковій системі.