Китайський ШІ-стартап DeepSeek представив попередній огляд оновленої серії мовних моделей. Головна V4-Pro перевершила Claude Opus 4.6 і GPT-5.4, зарекомендувавши себе як найкраща відкрита платформа.

🚀 Демонстрація DeepSeek-V4 офіційно доступна та з відкритим кодом! Вітаємо в епоху доступного контексту на 1 млн токенів.

🔹 DeepSeek-V4-Pro: 1,6 трлн загалом / 49 млрд активних параметрів. Ефективність на рівні передових закритих моделей у світі.

🔹 DeepSeek-V4-Flash: 284 млрд загалом / 13 млрд активних параметрів.… pic.twitter.com/n1AgwMIymu— DeepSeek (@deepseek_ai) 24 квітня 2026

Будова та обсяг

V4-Pro має приблизно 1,6 трлн параметрів, але на кожному етапі використовує лише 49 млрд. У другій версії — V4-Flash — сукупний обсяг становить 284 млрд, з яких задіюються 13 млрд.

Обидві моделі базуються на архітектурі «суміші експертів» (Mixture of Experts, MoE): під час опрацювання кожного токена активується тільки відповідна частина підмереж. Даний підхід економічніший за цілком щільні архітектури, але не поступається їм за продуктивністю.

Попереднє навчання відбулося на базі понад 32 трлн токенів. Згодом розробники поступово донавчали моделі, виділивши окремі блоки для кодування, математики, логіки та дотримання інструкцій. Остаточна версія поєднує ці вміння за допомогою дистиляції.

Тривалий контекст став більш доступним

Головною особливістю V4 стала оптимізація обробки розширених послідовностей. Контекстне вікно в 1 млн токенів є й в інших моделях, але його використання зазвичай асоціюється з високою ціною та затримками.

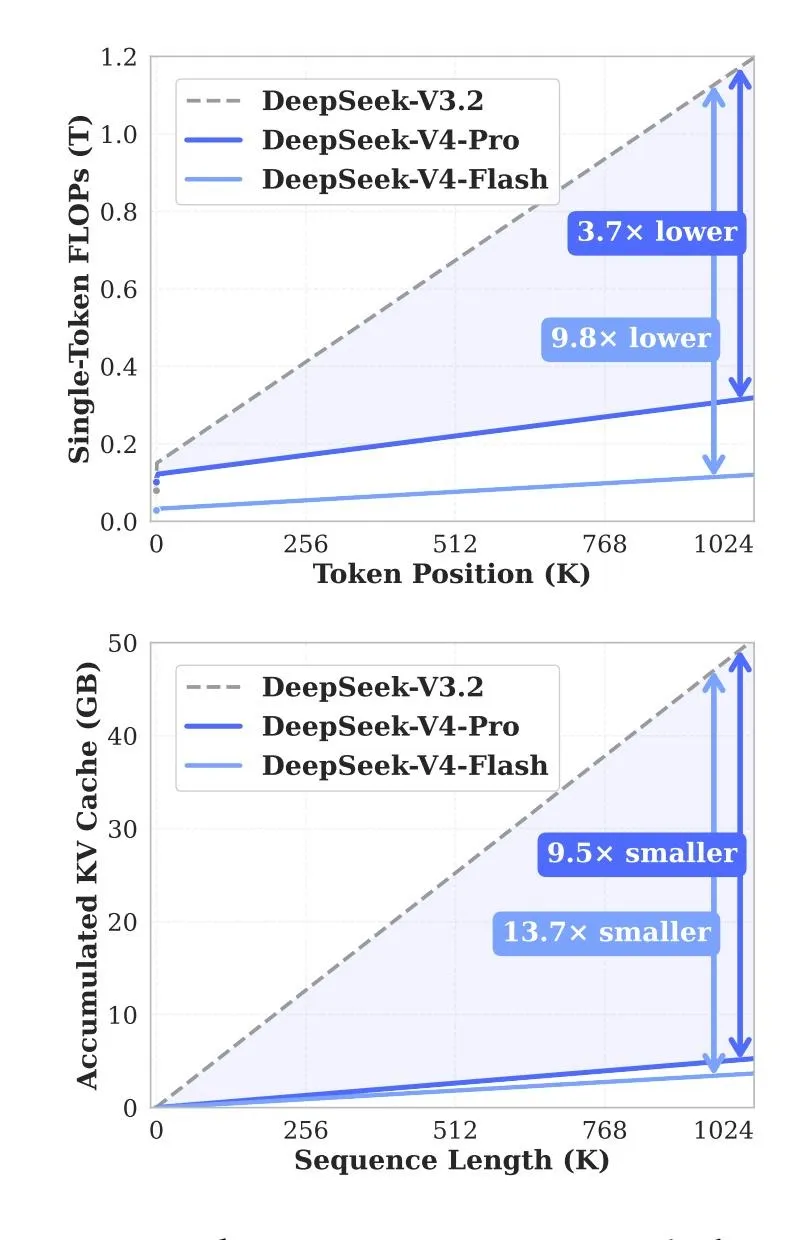

У DeepSeek запевнили, що нова версія відчутно зменшила ресурсомісткість таких операцій. У порівнянні з V3.2, V4-Pro потребує приблизно 27% обчислень і 10% пам’яті KV-кеша під час взаємодії з максимальним контекстом. Для V4-Flash показники становлять приблизно 10% і 7% відповідно.

Джерело: Hugging Face.

Команда досягла результату завдяки гібридній архітектурі уваги: два механізми стискають інформацію та полегшують навантаження під час роботи з об’ємними текстами. Також застосовано спеціальні гіперзв’язки для стабільності та оптимізатор Muon для прискорення навчання.

Режими обмірковування та агентські можливості

DeepSeek V4 підтримує три варіанти міркувань:

- Non-think — швидкі відповіді на прості питання без додаткового аналізу.

- Think High — поглиблений аналіз для комплексних завдань і планування.

- Think Max — найвищий режим: модель опрацьовує кожен етап і перевіряє всі альтернативи.

В агентних задачах режим Max тепер зберігає послідовність проміжних кроків в рамках однієї задачі. У попередній версії частина такого контексту втрачалася під час взаємодії з користувачем.

Результати тестування

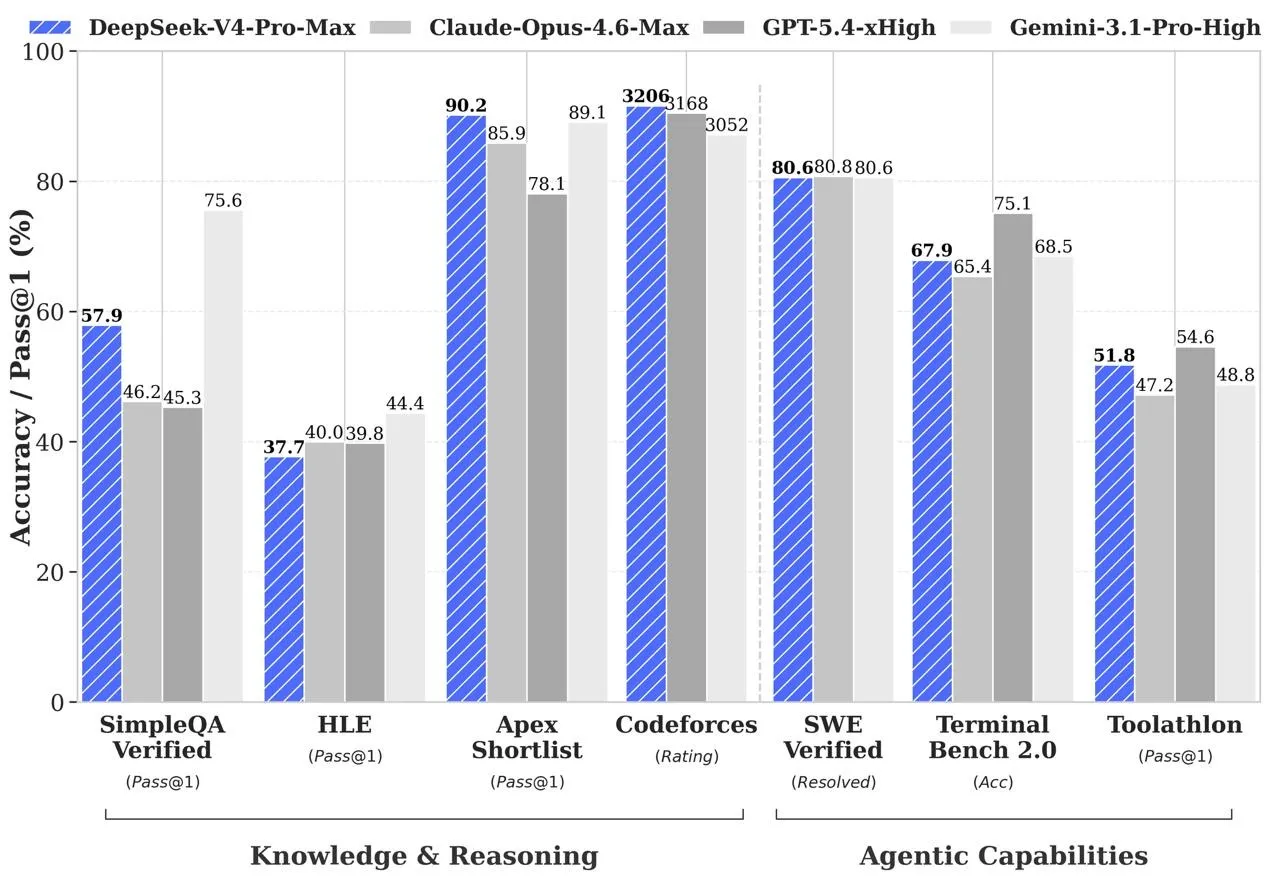

Згідно з даними DeepSeek, флагманська версія демонструє результати, порівнянні з провідними системами в ряді напрямків:

- у завданнях з програмування на Codeforces модель досягла рейтингу 3206 — 23-тє місце серед активних програмістів світу, на рівні з GPT-5.4;

- в математиці показала 95,2 на HMMT 2026 і 89,8 на IMOAnswerBench, обігнавши більшість конкурентів;

- у знаннях SimpleQA Verified — 57,9 (Opus 4.6 — 46,2, але Gemini 3.1 Pro — 75,6).

- у reasoning моделі поступаються GPT-5.4 і Gemini 3.1 Pro лише на три–шість місяців;

- у внутрішньому тесті DeepSeek, що охоплює розробку, налагодження та рефакторинг, модель досягла 67% — між Sonnet 4.5 (47%) та Opus 4.5 (70%);

- в агентних сценаріях і завданнях розробки V4-Pro-Max продемонструвала 80,6% на SWE Verified і 67,9% на Terminal Bench.

Джерело: Hugging Face.

V4 спеціально тренували на реальних випадках: аналіз даних, звіти, редагування документів, пошук в інтернеті з ітеративним застосуванням інструментів.

Для оцінки придатності моделі в реальній розробці стартап провів внутрішнє тестування на завданнях своїх інженерів. У опитуванні 85 розробників і дослідників 52% заявили, що готові використовувати V4-Pro як основну модель для кодування, ще 39% відзначили, що схиляються до такого рішення.

Нагадаємо, 23 квітня компанія OpenAI випустила GPT-5.5. Модель позиціонується як «новий рівень інтелекту для поточної роботи та керування агентами».