Фірма Google продемонструвала Gemma 4 — нову когорту відкритих ШІ-моделей для передових роздумів та агентних робочих процесів.

Ми щойно презентували Gemma 4 — наші найрозумніші відкриті моделі на сьогодні.

Створені на тій самій дослідницькій базі світового класу, що і Gemini 3, Gemma 4 впроваджують проривний інтелект безпосередньо на ваше обладнання для розширених міркувань і агентних робочих процесів.

Випущено під комерційною… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) April 2, 2026

«Gemma 4 — наші найрозумніші відкриті моделі на даний момент. Вони надають неперевершений рівень інтелекту на параметр», — йдеться у повідомленні.

З моменту випуску першого покоління розробники завантажили Gemma понад 400 млн разів, сформувавши понад 100 000 варіацій моделей в екосистемі Gemmaverse. Остання ітерація побудована на тих же дослідженнях і технологіях, що й чатбот Gemini 3.

Різноманітні розміри

Лінійка нейромереж Gemma 4 охоплює чотири модифікації: Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) і 31B Dense.

Компактні E2B та E4B на 2,3 млрд і 4,5 млрд активних параметрів роблять акцент на мультимодальність, незначну затримку та безшовну інтеграцію. Їх можна запустити на смартфоні або стандартному ноутбуці.

Для функціонування 26B MoE і флагманської 31B (на 26 млрд і 31 млрд параметрів) необхідний графічний прискорювач рівня Nvidia H100 з 80 ГБ пам’яті. Ці моделі оптимізовані для дослідників і програмістів.

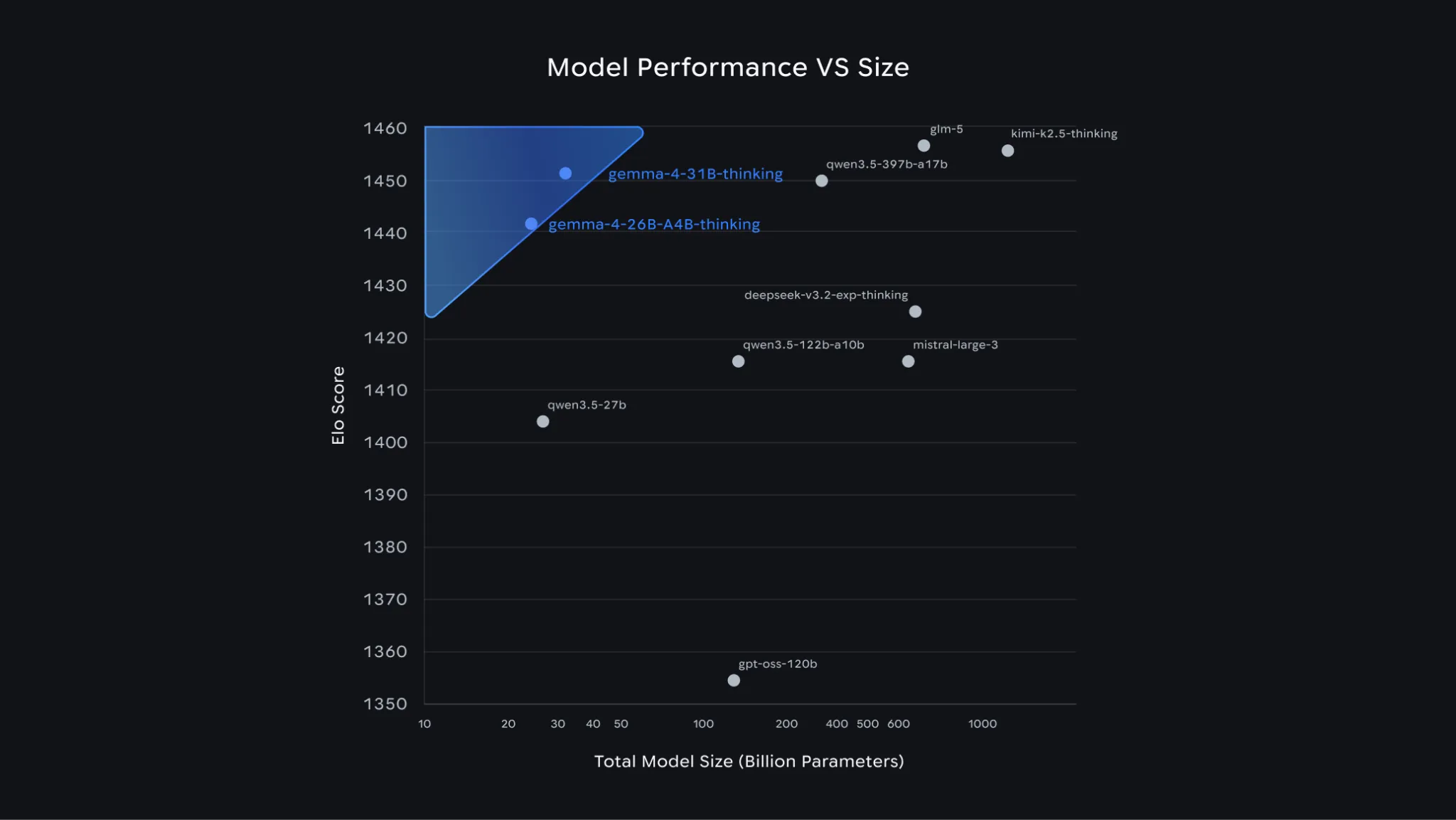

Більш потужні версії демонструють відмінні результати у бенчмарках. У глобальному рейтингу відкритих текстових моделей Arena AI флагманська 31B посідає третє місце, а 26B — шосте. Згідно зі словами розробників, нова серія перевершує аналогічні рішення від конкурентів, які в 20 разів більші.

Джерело: Google.

Головні можливості

Одна з ключових переваг Gemma 4 — розвинені здібності до розмірковування. Моделі здатні вибудовувати комплексну логіку та планувати завдання в декілька кроків. Вони показують значний прогрес у математичних бенчмарках і бездоганно слідують інструкціям.

Серед інших особливостей:

- агентні робочі процеси — вбудована підтримка виклику функцій, структурованого виводу у форматі JSON і системних інструкцій дає змогу створювати автономних помічників, що взаємодіють з інструментами та API;

- генерація коду — Gemma 4 підтримує якісне написання коду в офлайн-режимі, перетворюючи робочу станцію на локального ШІ-асистента;

- зір і аудіо — усі моделі обробляють відео та зображення з різною роздільною здатністю, ідентифікують текст і аналізують діаграми. E2B і E4B також підтримують розпізнавання та розуміння мовлення;

- розширене контекстне вікно — компактні версії підтримують 128 000 токенів, а більші — до 256 000. Цього достатньо для опрацювання цілих репозиторіїв або великих документів у межах одного запиту;

- багатомовність — сімейство моделей здатне працювати з більш ніж 140 мовами.

Gemma 4 вже наявна у Google AI Studio та Google AI Edge Gallery. Інтеграцію також забезпечують популярні сторонні інструменти та фреймворки, зокрема Hugging Face, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM і LM Studio.

Моделі можна кастомізувати через Google Colab, Vertex AI або на локальних відеокартах. Для продакшну доступне розгортання на Google Cloud, включно з Cloud Run, GKE та Sovereign Cloud.

Варто нагадати, на початку квітня Google представила нову модель ШІ для творення відео — Veo 3.1 Lite.