Китайська фірма Kuaishou оприлюднила третю ітерацію моделі для генерації відео під назвою Kling AI.

🚀 Introducing the Kling 3.0 Model: Everyone a Director. It’s Time.

An all-in-one creative engine that enables truly native multimodal creation.

— Superb Consistency: Your characters and elements, always locked in.

— Flexible Video Production: Create 15s clips with precise… pic.twitter.com/CJBILOdMZs— Kling AI (@Kling_ai) February 4, 2026

«Kling 3.0 працює на базі глибоко інтегрованої навчальної платформи, забезпечуючи справжній мультимодальний імпорт і експорт. Завдяки безшовній інтеграції аудіо та покращеному контролю узгодженості об’єктів, модель надає згенерованому контенту більш сильне відчуття життя та завершеності», — зазначено в оголошенні.

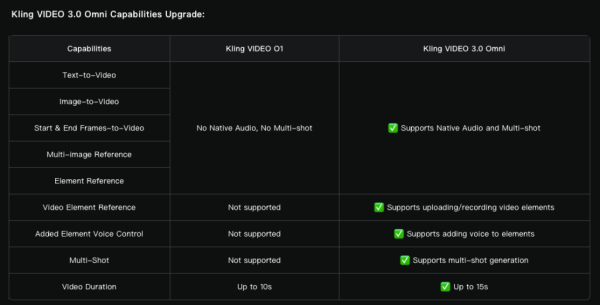

Модель поєднує декілька завдань: конвертацію тексту, зображень і посилань у відео, додавання або видалення вмісту, редагування і зміна роликів.

Тривалість відеороликів зросла до 15 секунд. Серед інших поліпшень — більш гнучке управління кадрами та більш точне слідування промтам. Підвищено загальний реалізм: рухи акторів стали більш виразними та жвавими.

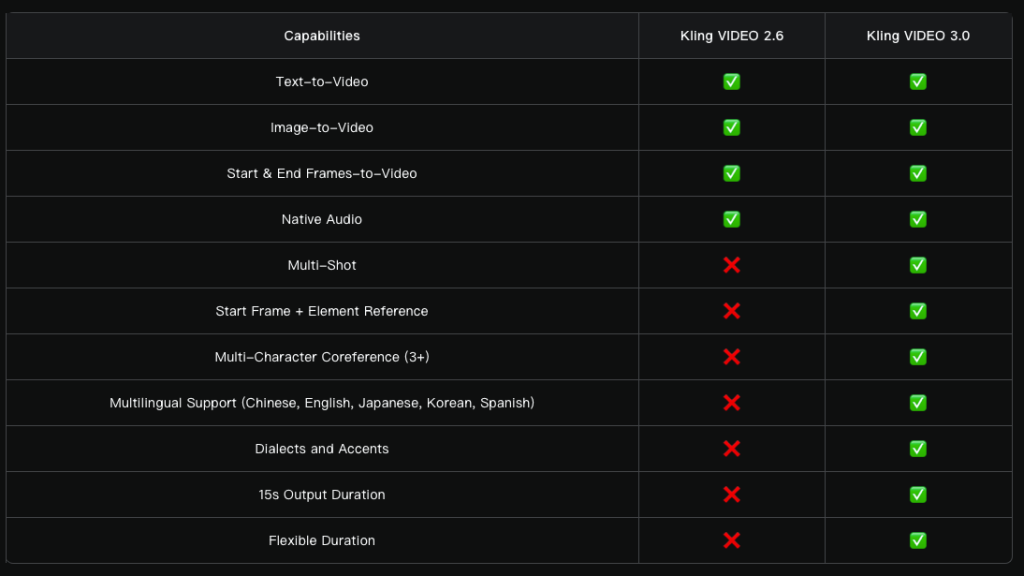

Порівняння Kling VIDEO 3.0 з Kling VIDEO 2.6. Джерело: Kling AI.

Нова опція Multi‑Shot аналізує запит, визначаючи структуру сцени та види кадрів. Інструмент автоматично налаштовує перспективи камери та композицію.

Модель підтримує різноманітні монтажні прийоми: від традиційних діалогів за схемою «кадр‑контркадр» до паралельного оповідання та сцен з закадровим текстом.

«Більше не потрібно нудно розрізати й збирати відео — однієї генерації достатньо, щоб створити кінематографічний ролик і зробити складні аудіовізуальні форми доступними для всіх авторів», — йдеться в релізі.

Kling 3.0 is truly “one giant leap for AI video generation”! Check out this amazing mockumentary from Kling AI Creative Partner Simon Meyer! pic.twitter.com/Iyw919s6OJ

— Kling AI (@Kling_ai) February 5, 2026

Окрім звичайної генерації відео за картинкою, Kling 3.0 підтримує одночасно кілька зображень як зразки, а також відео‑матеріали в якості об’єктів сцени.

Модель запам’ятовує особливості персонажів, речей і епізоду. Незалежно від руху камери та ходу історії, основні об’єкти залишаються стійкими й гармонійними протягом всього відео.

Розробники покращили вбудований аудіо: система більш точно узгоджує мовлення з мімікою, а в сценах з розмовами дозволяє самостійно визначати конкретного оратора.

Розширено список підтримуваних мов: китайська, англійська, японська, корейська та іспанська. Також поліпшено передачу говорів і акцентів.

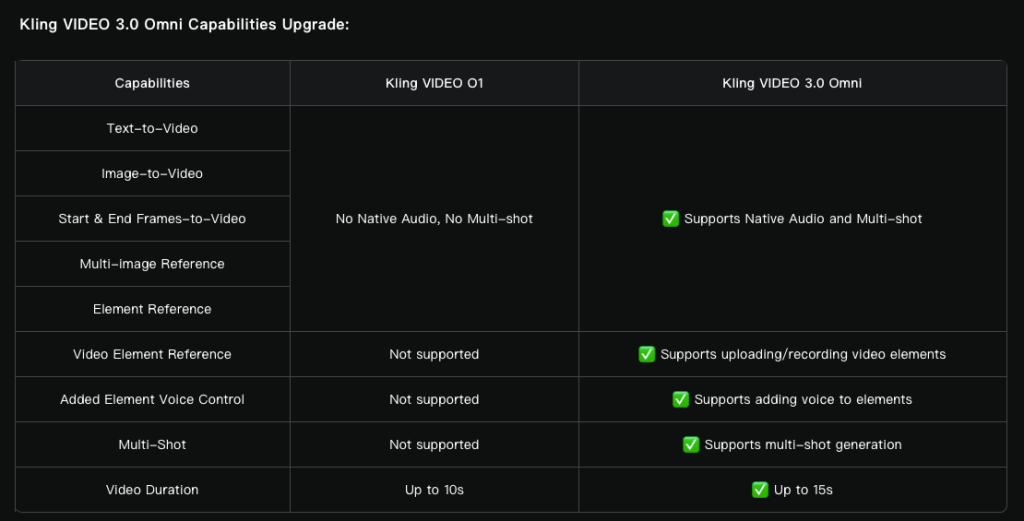

Окрім того, команда оновила мультимодальну модель O1 до Video 3.0 Omni.

Джерело: Kling AI.

Є можливість завантажити аудіо з вимовою від трьох секунд і виділити голос або записати відео з героєм тривалістю від трьох до восьми секунд для отримання його основних параметрів.

Конкуренти Sora наближаються

OpenAI анонсувала модель відеогенерації Sora в лютому 2024 року. Інструмент викликав фурор у соцмережах, однак публічний запуск відбувся лише в грудні.

Майже через рік користувачам надали доступ до створення відео за текстовими описами, «оживлення» зображень і доповнення готових роликів.

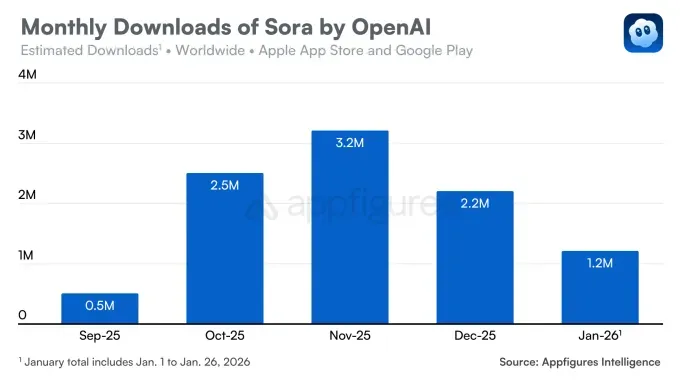

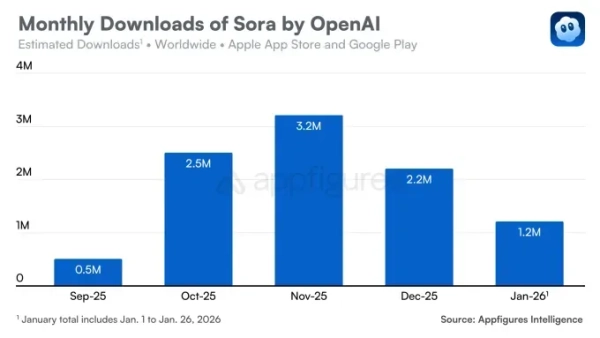

iOS‑додаток Sora з’явився у вересні та відразу привернув увагу аудиторії: у перший день його інсталювали понад 100 000 разів. Сервіс перевершив відмітку в 1 млн завантажень швидше за ChatGPT, незважаючи на доступ за запрошеннями.

Проте згодом тренд змінився. У грудні кількість завантажень знизилася на 32% у порівнянні з попереднім місяцем. У січні спадна динаміка збереглася — додаток завантажили 1,2 млн разів.

Джерело: Appfigures.

Спад викликаний низкою чинників. По‑перше, конкуренцію посилила модель Nano Banana від Google, яка підсилила позиції Gemini.

Sora також конкурує з Meta AI та її функцією Vibes. У грудні тиск на ринок збільшив стартап Runway, чия модель Gen 4.5 перевершила аналоги в незалежних тестах.

По‑друге, продукт OpenAI зіштовхнувся з проблемою порушення авторських прав. Користувачі створювали відео з популярними персонажами на зразок «Губки Боба» чи «Пікачу», через що компанії довелося посилити обмеження.

У грудні ситуація стабілізувалася після укладення угоди з Disney, яка дозволила користувачам генерувати відео з персонажами студії. Втім це не призвело до збільшення завантажень.

Нагадаємо, у жовтні діпфейки із Семом Альтманом заповнили Sora.